Für Gamer weltweit gibt die Zeit vor "der Geforce" und die Zeit danach. Als die Geforce 265 am 11. Oktober 1999 in den Läden stand, wurde sie als technische Sensation gefeiert. In den Nvidia-Beschreibung hieß es über die Grafikkarte damals, auf der Geforce arbeite ein "Einzelchipprozessor mit integriertem Setup für Umwandlungen, Beleuchtung und Dreiecke sowie mit Render-Engines, der mindestens 10 Millionen Polygone pro Sekunde verarbeiten kann." Übersetzt: Die Grafik in Spielen ist aus Vielecken aufgebaut, die sich je nach Perspektive in der Form verändern und entsprechend anders Licht reflektieren werfen. Die Geforce brachte einen Prozessor mit, der eigens auf diese Art von Berechnungen spezialisiert war: die Texture & Lightning-Einheit, kurz T&L.

Zuvor musste diese Arbeit neben allen anderen Berechnungen der Prozessor der Computers, die CPU, erledigen. Das war eher langsam und weil die CPU nicht schnell genug Bildern an den Monitor liefern konnte, ruckelte die Darstellung. Die 3D-Rechenarbeit war so fordernd, dass der T&L-Chip mit einem kleinen Lüfter gekühlt werden musste. Bisher kannte man das lärmende Gebläse nur vom Hauptprozessor des PC.

Auf Games spezialisierte Grafikkarten gab es auch vor der Geforce. Größter Konkurrent war die Voodoo 3Dfx mit der damals beliebten Grafikschnittstelle Glide. Das war zu einer Zeit, als PC-Games noch unter DOS liefen und Windows nicht viel mehr als eine grafische Oberfläche war. Unter DOS leistete Glide erstaunliches. Titel wie Tomb Raider 1 oder Descent ruckelten mit groben Pixeln mit 23 FPS über den Bildschirm, mit einer 3dfx-Karte waren es 40 bis 60 Frames per Second - mit glatten Oberflächen ohne sichtbare Pixel.

Doch die Voodookarten benötigen eine 2D-Grafikkarte als Basis. Das Signal der 2D-Grafikkarte wurde mittels eines Kabels zur 3D-Grafikkarte geleitet, erst von dort ging das Signal zum Monitor. Zudem drückte Microsoft seine Windows-Grafikschnittstelle DirectX in den Markt. Windows sollte zur Entertainment-Plattform werden. Multimedia war Ende der 90er Jahre in aller Munde. Schlechte Aussichten für 3dfx. Die Geforce beendete den 3dfX-Hype zunächst langsam, dann jedoch nahezu schlagartig. Dank T&L wurde die Spielegrafik flüssiger und detailreicher. Eine zusätzliche 2D-Grafikkarte entfiel, die Geforce konnte beides. 2001 wurde 3Dfx von Nvidia übernommen und abgewickelt.

Was machte Nvidia so besonders? Es war der erste Anbieter von Grafikkarten, der den Fokus auf die Beschleunigung von Games legte und enorme Summen in die Entwicklung neuer Architekturen und Programmierschnittstellen steckte. Die von immer besserer Grafik getriebene Gamingbranche erlebte Dank Nvidia einen enormen Aufschwung - und umgekehrt. Ender der 90er Jahre beschränkte sich das Berechnen einer fotorealistischen Szenen auf ein einzelnes Bild, heute werden fotorealistische Welten mit über 30 Bildern pro Sekunde berechnet - in einer Auflösung, die damals kaum Vorstellbar war.

Nvidia war vorausschauend und gab seinen Prozessoren einen neuen Gattungsnamen: Graphics Processing Unit, GPU. Künftig, so war sich Nvidia sicher, würde nicht mehr der Prozessor Auskunft über die Leistungsfähigkeit eines PC geben, sondern die Grafikkarte.

In den folgenden Jahren setzte Nvidia einen neuen Maßstab bei der Beschleunigung von realitätsnahen Grafiken nach dem anderen. Viele Meilenstein setzende Games wären ohne die Entwicklungen rund um die Geforce nicht möglich gewesen. Jahr um Jahr wurde Spielegrafik und die Beleuchtung der virtuellen Welten realistischer. Zugleich entbrannte ein harter Konkurrenzkampf zwischen den beiden letzten verbleibenden Grafikkartenherstellern: Nvidia und AMD (früher ATI). Jede Seite versuchte, mit eigenen Techniken und exklusiven Kooperationen mit den Spieleentwicklern Kunden an sich zu binden.

Nvidia hatte Recht behalten. 25 Jahre später spielt der Hauptprozessor nur noch die zweite Geige im Leistungskonzert. Jedenfalls wenn eine der derzeit neusten Geforce-Generation der 4080 und 4090-Serie im Rechner steckt und es um Raytracing, dem realistischen Berechnen von Lichtstrahlen und der Grafikberechnung mittels KI geht.

Wo viel Licht ist, da ist auch Schatten. Die erste Geforce kam für 269 US-Dollar auf den Markt, was heute etwa 500 US-Dollar entspräche, die neuste Generation kostet das Vierfache. Auch der "Unterhalt" stieg spürbar an. Unter Volllast verlangt eine Geforce GTX 4090 rund 400 KWh Strom. Wer täglich zwei Stunden spielt, wird das in der Jahresendabrechnung seines Stromanbieters deutlich merken.

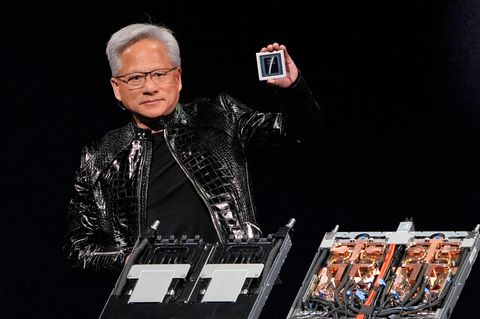

Gaming ist für Nvidia zum Nebenschauplatz geworden. Das große Geld wird mit den KI-Chip Tensor verdient, für den es derzeit praktisch keinen Konkurrenten gibt.