Gutenberg ist schuld. Seine Erfindung des Buchdrucks hat in letzter Konsequenz dazu geführt, dass die Gesellschaft den öffentlichen Diskurs, Kreativität und Nachrichten als "Inhalt" betrachtet. Als eine Ware, mit der die Produkte gefüllt werden, die wir Publikationen oder seit einiger Zeit Websites nennen. Viele Journalisten glauben heutzutage, dass der Wert ihrer Arbeit vornehmlich in der Erstellung von Inhalten liegt. Man muss sich diese Haltung vor Augen führen, möchte man den Nutzen und die Gefahren von künstlicher Intelligenz (KI) für den Journalismus verstehen.

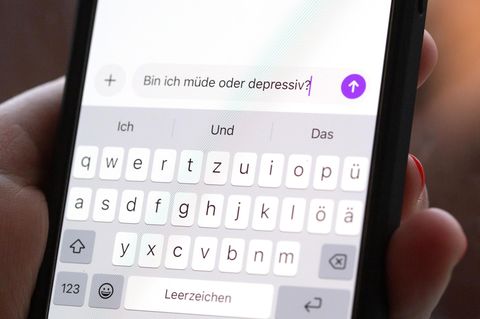

Denn sie bringt Maschinen hervor – generative künstliche Intelligenz oder große Sprachmodelle wie ChatGPT –, die ohne Ende Inhalt erstellen können: Texte, die genauso klingen, als hätten wir sie selbst verfasst, weil sie mit all unseren Wörtern trainiert wurden. Die Modelle haben kein Verständnis für die Bedeutung der Wörter, kein Konzept von Wahrheit. Sie sind lediglich so programmiert, dass sie mit hoher Wahrscheinlichkeit vorhersagen können, wie das nächste Wort in einem Satz lauten sollte.

Die Tücken der Künstlichen Intelligenz

Ein New Yorker Anwalt namens Steven Schwartz musste die Fehlbarkeit von ChatGPT schmerzlich erfahren. In einem mittlerweile berüchtigten Verfahren nutzte er die Software, um Präzedenzfälle zu suchen. Es ging in seiner Klage um einen außer Kontrolle geratenen Servierwagen in einem Flugzeug und das angeblich verletzte Knie seines Mandanten. ChatGPT lieferte ihm pflichtbewusst mehr als ein halbes Dutzend Fallzitate.

Nachdem die Kanzlei ihren Schriftsatz bei Gericht eingereicht hatte, erklärte die gegnerische Seite, sie könne die Fälle nicht finden. Schwartz wandte sich also erneut an ChatGPT und bat den Bot, ihm die vollständigen Fälle zu zeigen, was ChatGPT prompt tat, versehen mit passenden juristischen Abhandlungen.

Der Richter nannte sie "juristisches Kauderwelsch" und bestellte Schwartz und seine Kollegen vor Gericht. Ich war einer der anwesenden Journalisten und erlebte die öffentliche Demütigung der Anwälte mit. Denn die vermeintlichen Präzedenzfälle hatte der Bot selbstständig konstruiert.

"Die Welt kennt jetzt die Gefahren von ChatGPT", sagte der Anwalt der Anwälte zum Richter. Das Gericht habe seine Aufgabe erfüllt, die Öffentlichkeit vor diesen Risiken zu warnen. Der Richter unterbrach ihn: "Das hatte ich gar nicht vor." Nicht die Technologie war das Problem, sondern die Anwälte, die sie benutzten, die Warnungen über die zweifelhaften Präzedenzfälle ignorierten, die es versäumten, sie zu überprüfen. Der Anwalt der Anwälte sagte, Schwartz "spielte mit scharfer Munition. Er war sich dessen nicht bewusst, weil die Technik ihn angelogen hat."

Aber ChatGPT hat nicht gelogen, weil er wie gesagt kein Konzept von Wahrheit hat. Er hat auch nicht "halluziniert", wie seine Erfinder es nennen. Er hat lediglich Wortfolgen vorhergesagt, die richtig klangen, es aber nicht waren.

"Kauderwelsch aus der Maschine"

Der Fall dient als ein warnendes Beispiel für Medienunternehmen, die sich auf die neue Technologie stürzen, um die Bots Texte schreiben zu lassen – etwa weil sie cool und trendy erscheinen, Arbeit einsparen, vielleicht Jobs abbauen und trotzdem immer mehr Inhalte produzieren wollen. In den USA sind einige Medienunternehmen in die Kritik geraten, weil sich ihre von KI erstellten Inhalte als faktisch falsch erwiesen hatten. Amerikas größte Zeitungskette, Gannett, hat gerade die Nutzung eines KI-Tools eingestellt, das peinliche Berichte über Sportveranstaltungen generierte. Ein Footballspiel wurde, als hätten Außerirdische teilgenommen, als "Nahbegegnung der sportlichen Art" bezeichnet.

Redakteuren und Verlegern rate ich, die Sprachmodelle für das Verfassen von Nachrichten zu meiden und sie lediglich bei bewährten Anwendungen einzusetzen, wie der Umwandlung von Finanzberichten in einfache Nachrichtenmeldungen. Vor ihrer Veröffentlichung müssen die Texte zudem überprüft werden. Faktenfreies Kauderwelsch aus der Maschine könnte die Autorität und Glaubwürdigkeit sowohl von Medien- als auch von Technologieunternehmen zerstören – und den Ruf der künstlichen Intelligenz insgesamt beeinträchtigen.

Es gibt gute Anwendungen für KI. Ich profitiere jeden Tag davon, zum Beispiel wenn ich Google Translate, Maps, Assistant und die Autovervollständigung nutze. Programme wie ChatGPT können die Arbeit von Journalisten nicht ersetze, aber ergänzen. Ich habe vor Kurzem ein neues Tool namens NotebookLM getestet. Diese App kann einen Ordner mit den Recherchen eines Journalisten zusammenfassen und den Inhalt strukturieren. KI-Software könnte auch im Sprachunterricht sinnvoll genutzt werden, wo es auf die Beherrschung der Sprache und nicht auf Fakten ankommt. Ich glaube sogar, dass sie zur Erweiterung der Lese- und Schreibkompetenz eingesetzt werden kann. Menschen, für die das Schreiben einschüchternd ist, könnte damit geholfen werden, effektiver zu kommunizieren und ihre Geschichten zu erzählen.

Sorge vor wachsender Desinformation

Für Schreibende wie mich liegt darin allerdings ein Haken. Als Journalisten sind wir Geschichtenerzähler und verfügen über die Macht, die Geschichten anderer zu erzählen, zu entscheiden, welche erzählt werden, wer darin vorkommt, wie sie beginnen und wie sie enden. Wir glauben, dass uns das in die Lage versetzt, die Welt auf eine sinnvolle Weise zu erklären. Die KI sehen Autoren und Journalisten als Konkurrenz. Indem die in Sekundenschnelle auf den ersten Blick glaubwürdige Prosa generiert, entwertet sie das Schreiben und beraubt die Autoren ihres Status.

Dies ist aus meiner Sicht einer der Gründe, warum wir eine feindselige Berichterstattung über neue Technologien in den Medien erleben. Nun hat Journalisten erneut eine übertriebene Aufgeregtheit erfasst – die jüngste in einer langen Reihe von Panikanfällen über Filme, Fernsehen, Comics, Musiktexte und Videospiele. Sie warnen vor den Gefahren des Internets, der sozialen Medien, unserer Telefone und jetzt auch der künstlichen Intelligenz und behaupten, dass diese Technologien uns verdummen, abhängig machen, Arbeitsplätze wegnehmen und die Demokratie durch eine Flut an Desinformation zerstören werden.

Sie sollten sich wieder abregen. Eine Studie aus dem Jahr 2020 zeigt, dass sich in den USA keine Altersgruppe "durchschnittlich mehr als eine Minute pro Tag mit Fake News beschäftigt hat und diese auch nicht mehr als 0,2 Prozent ihres gesamten Medienkonsums ausmachten". Das Problem für die Demokratie ist weniger die Desinformation als die Bereitschaft einiger, Lügen zu glauben, die ihre eigenen Ängste und ihren Hass schüren. Der Journalismus sollte über die Wurzeln von Fanatismus und Extremismus berichten und nicht die neuen Technologien dafür verantwortlich machen.

In meinem Buch "The Gutenberg Parenthesis" untersuche ich den Beginn des Druckzeitalters, das wir nun allmählich in Richtung des digitalen Zeitalters verlassen. Am Anfang war das Gerücht vertrauenswürdiger als das Gedruckte, denn jeder konnte anonym ein Buch oder ein Flugblatt herstellen – so wie heute jeder eine Website bauen oder einen Tweet verfassen kann. Im Jahr 1470 – nur 15 Jahre nach der Veröffentlichung der Gutenberg-Bibel – forderte der lateinische Gelehrte Niccolò Perotti zum ersten Mal eine Zensur der gedruckten Schriften. Er war von der schlechten Übersetzung einer Plinius-Ausgabe derart entsetzt, dass er an den Papst schrieb und ihn aufforderte, einen Korrektor zu ernennen, der alle Texte vor dem Druck überprüfen sollte. Als ich darüber nachdachte, wurde mir klar, dass es Perotti nicht um Zensur ging. Vielmehr sah er die Einrichtung von Redaktionen und Verlagen vorher, die über Jahrhunderte hinweg die Qualität und Autorität im Druck gewährleisten sollten.

Chancen und Risiken abwägen

Wie seinerzeit Perotti fordern Medien und Politiker heutzutage, dass etwas gegen schädliche Online-Inhalte unternommen werden müsse. Regierungen – wie auch Redakteure und Verleger – sind dem Umfang an Inhalten und Beiträgen nicht mehr gewachsen, weshalb sie Plattformen damit beauftragen, alles, was online geäußert wird, zu überwachen und zu zensieren. Das aber ist ein unmögliches Unterfangen.

Wie wir gesehen haben, müssen Journalisten bei der Nutzung von KI vorsichtig sein, zugleich besteht die Gefahr, die Technologie zu verteufeln. Im besten Fall könnte in der weiteren Entwicklung der KI eine Chance für den Journalismus liegen: wenn sie Journalisten dazu bringt, über ihre Rolle in der Gesellschaft neu nachzudenken und sich zu fragen, wie sie den öffentlichen Diskurs verbessern können. Das Internet bietet ihnen neue Möglichkeiten, mit Gemeinschaften in Kontakt zu treten, Beziehungen des Vertrauens und der Autorität zu ihnen aufzubauen, ein offenes Ohr für ihre Bedürfnisse zu haben, Stimmen zu entdecken, die zu lange nicht gehört wurden, und ihnen eine Plattform zu bieten sowie die Arbeit des Journalismus über das Publizieren hinaus auf das Internet auszuweiten.

Der Wert der Journalisten liegt nicht allein in den Inhalten, die sie erstellen. Er liegt darin, über Gemeinschaften zu berichten und ihnen zu dienen. Wie Nicolò Perotti sollten wir die Entwicklung neuer Internetdienste antizipieren: Dienste, die Nutzern helfen, den Umfang der Inhalte zu bewältigen, ihren Wahrheitsgehalt zu überprüfen, die Autorität von Nachrichtenquellen zu beurteilen, unterschiedliche Stimmen zu entdecken, Talente zu fördern sowie Inhalte zu empfehlen, die unsere Zeit und unsere Aufmerksamkeit verdienen. Vielleicht könnte das die Grundlage für einen neuen Journalismus im Zeitalter von KI sein.

Übersetzung: Anuschka Tomat