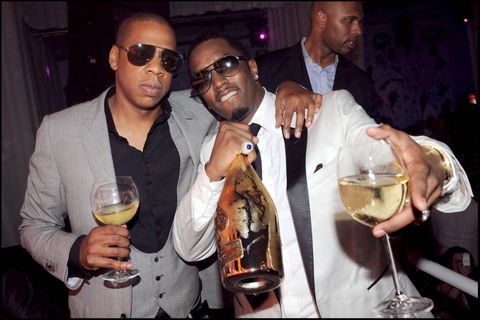

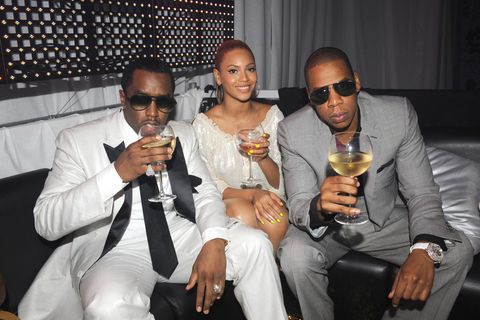

Man muss schon sehr genau hinhören: Wenn Rapper Jay-Z in seinem typischen Flow "We didn't start the fire" von Billy Joel rappt, klingt das wie eine glaubwürdige Acappela-Version des Rock-Klassikers. Höchstens einige etwas abgehackte Übergänge lassen etwas stutzen. Doch der weltbekannte Rapper und Ehemann von Beyonce hat den Song nicht gecovert. Der Text wurde ihm von einer künstlichen Intelligenz in den Mund gelegt.

Den Begriff Deepfake kennt man bisher vor allem im Videobereich. Mit Hilfe von Maschinenlernen konnten dort Algorithmen Personen in Videoclips montieren. So wurden etwa Mark Zuckerberg in einem Clip eine Brandrede gegen Facebook in den Mund gelegt oder sich über den US-Präsidenten Donald Trump amüsiert. Und natürlich gab es auch mit gefälschten Pornos einen Missbrauch der Technologie.

Gangstarap vom Präsidenten

Nun sind die Deepfakes auch bei der Stimme angekommen. Auf einem Youtube-Kanal und bei Reddit sammeln sich immer mehr Clips des unter dem Pseudonym Voice Synthesis bekannten anonymen Erstellers an, in denen Musikern, Politikern und anderen Promis berühmte Gedichte, Songs und Quatschtexte in den Mund gelegt werden. So dürfen etwa gleich fünf US-Präsidenten den Gangstarap-Klassiker "Fuck the police" von NWA zum besten geben, Frank Sinatra den Abba-Hit "Dancing Queen" trällern. Oder Jay-Z die Tragödie um Darth Plagueis dem Weisen aus "Star Wars" in seinem typischen Rapflow nacherzählen.

Die Technologie ist dabei dieselbe wie bei Deepfakes. Die künstliche Intelligenz wird mit Unmengen von Rohmaterial der Politiker, Sänger und Rappern trainiert, lernt so, deren typische Betonung, den Sprach- oder Gesangsrhythmus und die Tonlage bis ins kleinste Detail kennen - und kann sie dann auf neue Inhalte wie Songs, Gedichte oder Reden übertragen.

Wem gehört eine Stimme?

Dem Rapper passte das offenbar überhaupt nicht. Er ließ die Clips mit "seiner" Stimme von Youtube entfernen - mit Verweis auf sein Urheberrecht, berichtet "Pitchfork". "Diese Inhalte benutzen ohne rechtliche Grundlage künstliche Intelligenz, um die Stimme unseres Mandanten zu imitieren", schrieb laut dem Betreiber des Youtube-Kanals Jay-Zs Firma Roc Nation. Doch wenige Tage später waren die Clips wieder da. Die Anfragen zum Herunternehmen seien "unvollständig" gewesen, erklärte Youtube gegenüber "Pitchfork". Sie seien nun wieder live gestellt worden, bis die Situation geklärt sei. Eine Anfrage an den Rapper blieb unbeantwortet.

Dessen rechtliche Handhabe fällt laut US-Urheberrechtsexperten erschreckend gering aus. "Dieser Anspruch auf Urheberrecht ist ein Witz", urteilte etwa der aus Musik- und Medienrecht spezialisierte Anwalt Bill Hochberg. Er vertritt unter anderem die Erben von Bob Marley. "Man kann nicht einfach einen Gesangsstil schützen lassen." Auch ein ehemaliger Musik-Manager teilte gegenüber der Webseite diese Einschätzung. Und tatsächlich ließen sich bisher keine Anzeichen für rechtliche Schritte seitens des Labels finden, so "Pitchfork".

Wo ist die Grenze?

Dabei wäre eine Klärung der Rechtsproblematik wohl dringend nötig. Der Fall wirft nämlich ganz grundsätzliche Fragen auf. Wem gehört eine Stimme? Wozu darf sie genutzt werden? Und wo verläuft Grenze von Satire? Schließlich gab es schon vorher Cover und Nachahmungen von Musikern und Politikern - nur eben von menschlichen Imitatoren.

Tatsächlich sind auch die Clips des Youtube-Kanals alle klar als Fakes und Satire deklariert, niemand versucht hier vorzugeben, es handle sich um echte Aufnahmen. Dass sie trotzdem gruseliger wirken, als die eines menschlichen Imitators, hat vermutlich mehrere Gründe. Zum einen muss man sich im Gegensatz zu einem gut geübten Imitator nicht ewig mit dem Sprech- oder Gesangsmuster einer anderen Person befassen, sondern überlässt das komplett dem Computer. Zum anderen schwingt bei den KI-Imitationen auch noch das weitere Potenzial der Technologie mit. Schließlich lässt sich die Technologie nicht nur für lustige Einsatzzwecke nutzen.

Viel Potenzial für Missbrauch

Diese Angst ist nicht unberechtigt. Bereits letzten Sommer wurde eine Deepfake-Stimme eines Managers benutzt, um eine Angestellte eines Energieunternehmens zur Freigabe einer Überweisung von 220.000 Euro zu bewegen. Von dem von England nach Ungarn überwiesenen Geld fehlt jede Spur. Und warum sollten etwa Werbefirmen viel Geld für eine Promi-Stimme bezahlen, wenn auch eine günstige Imitation die eigenen Produkte anpreisen kann?

Auch in der Musikindustrie könnte die Technologie noch für Furore sorgen. Während die Clips von Jay-Z und Co. bisher nur bekannte Stücke rezitieren, macht sich das Projekt Jukebox von OpenAI schon für den nächsten Schritt bereit: Auf der Plattform Soundcloud präsentiert es ein komplett von KI erstelltes Musikstück nach dem anderen, stets inspiriert von den typischen Klängen eines Genres oder gar eines einzelnen Künstlers. Und baut so völlig neue Songs zum Teil längst verstorbener Künstler wie Elvis Presley oder Frank Sinatra.

Noch klingen die Lieder eher krude und oft recht generisch. Ein Hörgenuss sind sie meist nicht. Noch nicht, ist sich der anonyme Betreiber von Voice Synthesis sicher. "Wir haben kaum an der Oberfläche gekratzt", sagte er "Pitchfork". "Ich bin wirklich gespannt, wie sich das alles in den nächsten Jahren entwickeln wird."